TikTok. Depuis l’entrée en vigueur dans l’Union européenne du Digital Services Act (DSA), en août 2023, les réseaux sociaux doivent répondre à plusieurs obligations. L’une d’elles est de publier un rapport de transparence, sur les contenus supprimés sur leurs plateformes. Avec le DSA, les réseaux sociaux ont l’obligation de prendre des mesures concrètes pour éviter la propagation de contenus de contenus inappropriés. C’est aussi un moyen d’obtenir des chiffres plus concrets sur l’utilisation des plateformes en Europe, et dans le monde.

TikTok vient de publier son sixième rapport de transparence, qui porte sur le deuxième semestre de l’année 2025, entre juillet et décembre 2025. Ces données sont toujours très attendues, car la plateforme ne cesse d’être sous le feu des projecteurs, notamment en France à la suite de la commission d’enquête menée par Arthur Delaporte l’année dernière.

Que faut-il retenir du sixième rapport de transparence de TikTok?

En 2025, il y a de plus en plus d’utilisateurs sur TikTok. En Europe, on compte 178 millions d’utilisateurs mensuels au second trimestre de l’année, ce qui représente 8 millions d’utilisateurs supplémentaires par rapport au début de l’année 2025. Mais, avec davantage d’utilisateurs sur l’application, on note plus de contenus problématiques publiés sur TikTok.

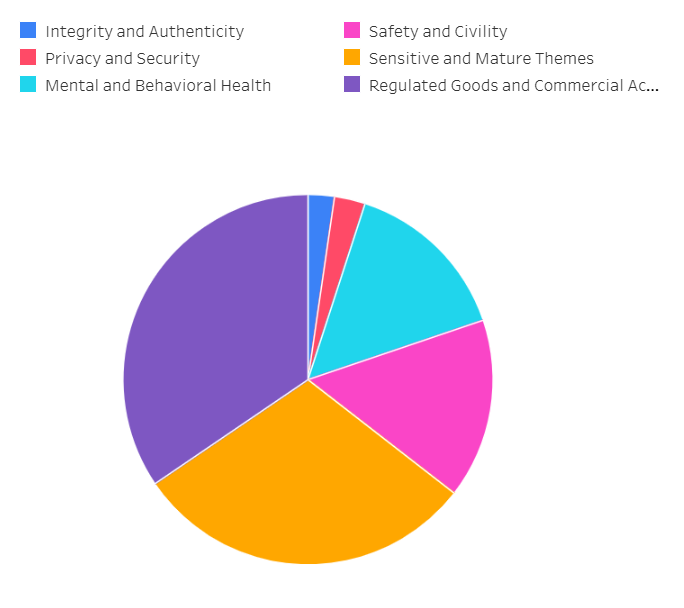

Le rapport de transparence dévoile que 112 millions de contenus ont été supprimés dans le monde entier, dont 2,6 millions au Royaume-Uni, 1,9 million en Allemagne et 1,7 million en France. Ces contenus supprimés sont des vidéos, des lives, des publicités, des fiches produits, et pour la toute première fois, des commentaires publiés par des utilisateurs. TikTok est également vigilant en ce qui concerne les faux comptes et les faux likes. Il s’agit en majorité de contenus faisant la promotion de produits réglementés (34,5%) ou en lien avec des sujets matures et sensibles (30%).

TikTok félicite sa modération automatisée par l’intelligence artificielle. Pendant cette période, 93,8% des contenus illicites ont été détectés sans intervention humaine. Après vérification, 97,6% des décisions automatisées ont été confirmées comme étant correctes. Pour aider les équipes de TikTok a repéré les contenus illégaux, les utilisateurs européens peuvent « signaler un contenu illégal ». Si la vidéo ne viole pas les règles du réseau social, mais semble illégale, elle est transférée à une équipe spécialisée pour examen juridique. « Il n’y a pas de ligne d’arrivée lorsqu’il s’agit de garantir la sécurité de notre communauté sur notre plateforme. Avec chaque rapport, nous renforçons notre engagement en matière de transparence et de responsabilité », déclare TikTok dans un communiqué.